Le 21e siècle a vu l'IA (intelligence artificielle) accomplir des tâches telles que vaincre facilement des humains aux échecs ou leur apprendre rapidement des langues étrangères..

Une tâche plus avancée pour l'ordinateur consisterait à prédire la probabilité qu'un délinquant commette un autre crime. C'est le travail d'un système d'IA appelé COMPAS (Correctional Offender Management Profiling for Alternative Sanctions). Mais il s'avère que cet outil n'est pas meilleur qu'un type moyen et peut aussi être raciste. Eh bien, c'est exactement ce qu'une équipe de recherche a découvert après avoir étudié de manière approfondie le système d'IA largement utilisé par les institutions judiciaires..

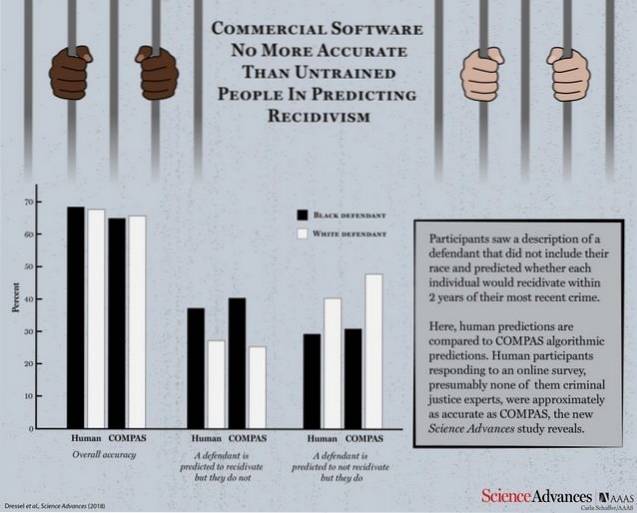

Selon un article de recherche publié par Science Advances, COMPAS a été opposé à un groupe de participants humains pour tester son efficacité et vérifier sa performance par rapport aux prédictions logiques faites par une personne normale. La machine et les participants humains ont reçu 1000 descriptions de tests contenant l'âge, les crimes antérieurs, le sexe, etc. des délinquants dont la probabilité de récidive devait être prédite..

Avec beaucoup moins d'informations que COMPAS (seulement 7 caractéristiques par rapport aux 137 de COMPAS), une petite foule de non-experts est aussi précise que COMPAS pour prédire la récidive.

COMPAS a obtenu une précision globale de 65,4% dans la prédiction de la récidive (la tendance d'un criminel condamné à récidiver), ce qui est inférieur à la précision de prédiction collective des participants humains qui se situe à 67%..

Maintenant, prenez un moment et réfléchissez à votre esprit que le système d'IA, qui ne vaut pas mieux qu'une personne moyenne, a été utilisé par les tribunaux pour prédire la récidive..

Les logiciels commerciaux largement utilisés pour prédire la récidive ne sont ni plus précis ni plus équitables que les prédictions des personnes ayant peu ou pas d'expertise en justice pénale qui ont répondu à un sondage en ligne..

Ce qui est encore pire, c'est que le système s'est avéré tout aussi sensible aux préjugés raciaux que ses homologues humains lorsqu'on leur a demandé de prédire la probabilité de récidive à partir de descriptions contenant également des informations raciales sur les délinquants. Vous ne devriez pas être trop surpris là-bas, car l'IA est connue pour adopter les modèles que ses enseignants humains la programmeront pour apprendre..

Bien que les deux côtés ne parviennent pas à atteindre un score de précision acceptable, l'intérêt d'utiliser un outil d'IA qui n'est pas meilleur qu'un être humain moyen soulève de nombreuses questions.

Gadgetshowto

Gadgetshowto