Notre expérience de première main avec la technologie de reconnaissance d'image IA, Google Lens, a montré que l'apprentissage automatique a sûrement parcouru un très long chemin. Mais cette technologie est actuellement loin d'être parfaite et pas aussi intelligente que nous l'espérions, principalement parce que le rythme auquel nous formons les ordinateurs pour identifier les modèles est lent. De plus, certaines IA nécessitent des calculs avancés pour le réseau neuronal, et ce n'est certainement pas la tâche la plus facile d'enseigner une machine..

Gardant cela à l'esprit, un groupe de chercheurs de Google a décidé de mettre à l'épreuve les systèmes de reconnaissance d'images par IA et de voir s'ils pouvaient être trompés ou non..

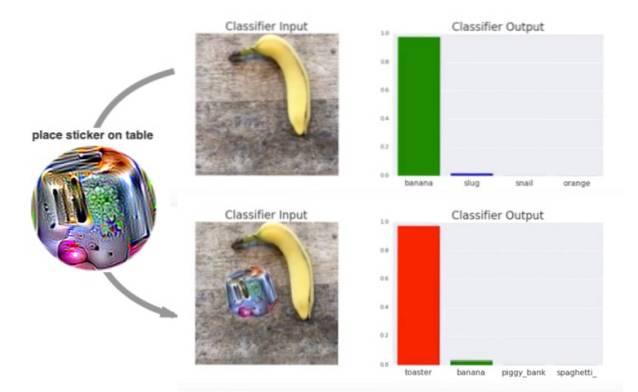

Il semble qu'ils sont sortis victorieux depuis le Le système d'IA n'a pas réussi à reconnaître l'objet (ici, une banane) dans les images d'exemple, le tout grâce à un autocollant psychédélique spécialement imprimé.

La création de ces autocollants psychédéliques qui peuvent duper les systèmes de reconnaissance d'images, comme décrit dans un article de recherche intitulé Adversarial Patch, qui vient d'être présenté à la 31e conférence sur les systèmes de traitement de l'information neuronale en décembre 2017. L'article explique que les chercheurs ont formé un système d'adversaire (adversaire) à créer de petits cercles psychédéliques en forme de patch avec des formes, des couleurs et des tailles aléatoires pour tromper la reconnaissance d'image système.

Alors que la méthode la plus courante pour tromper les systèmes de reconnaissance d'images IA consiste à modifier une image en y ajoutant des graphiques, les chercheurs de Google ont décidé de tromper le système avec des conceptions psychédéliques..

Comme le montre la vidéo de démonstration ci-dessous, le système est capable de reconnaître la banane et, dans une certaine mesure, le grille-pain lorsque vous placez une image normale à côté de la banane. Mais les résultats sont moins clairs lorsqu'un tourbillon psychédélique est placé à côté de la banane:

L'équipe a également constaté qu'un la conception corrigée semble distincte du sujet et n'est pas affectée par des facteurs tels que les conditions d'éclairage, les angles de caméra, les objets dans la vue du classificateur et le classificateur lui-même.

Les chercheurs expliquent ensuite le fonctionnement des conceptions psychédéliques:

Cette attaque génère un patch indépendant de l'image qui est extrêmement important pour un réseau neuronal. Ce patch peut ensuite être placé n'importe où dans le champ de vision du classifieur, et oblige le classifieur à générer une classe ciblée.

Alors qu'à première vue, il semble que la reconnaissance d'image AI est dupée, cette expérience sera en fait utilisée pour supprimer les incohérences dans le système. Ceux qui travaillent dans ce domaine doivent maintenant s'adapter aux données bruyantes qui peuvent être incluses dans les images du sujet. Cette découverte pourrait donner aux systèmes basés sur l'apprentissage automatique une chance de s'améliorer contre une tromperie similaire à l'avenir.

Gadgetshowto

Gadgetshowto